はじめに

G検定の試験勉強、お疲れ様です。

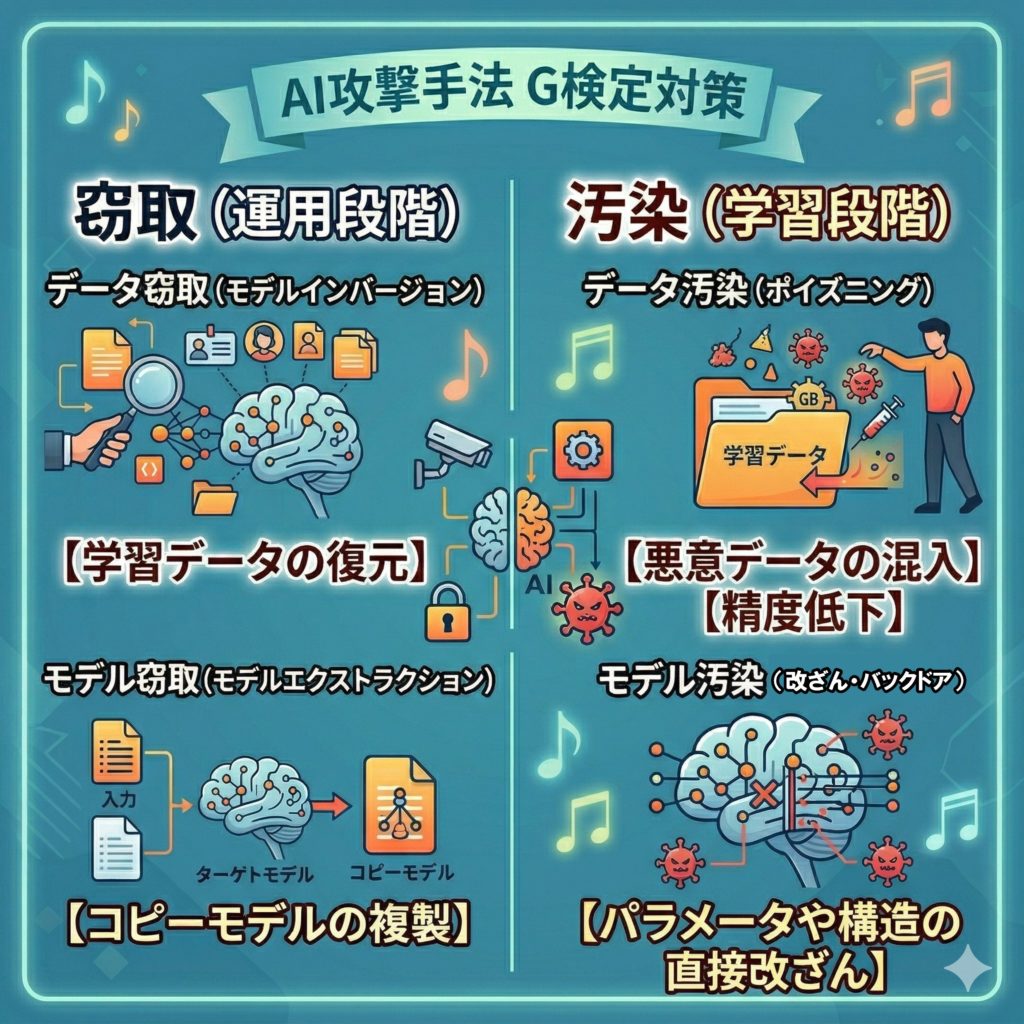

AIのセキュリティ分野で出題されるAIに対する攻撃手法(データ窃取、モデル窃取、データ汚染、モデル汚染)は、名前が似ていて違いの覚え方が難しいですよね。

特に「ポイズニング攻撃」や「モデルインバージョン攻撃」などが、学習段階の攻撃なのか、運用段階の攻撃なのか、試験本番で混乱してしまう方も多いはずです。

そこで今回は、試験問題で間違えないように、単語の意味と分類を音楽のリズムに合わせて覚えられるオリジナルの暗記ソング「AIへの攻撃手法覚えうた」を作成しました。

ぜひ、勉強の息抜きや直前対策のチートシート代わりに活用してください。

AIを活用した楽曲制作

今回の楽曲制作にあたっては、2つの生成AIツールを活用しています。

歌詞の作成には生成AI(Gemini)を使用し、試験に出る重要なキーワードや定義を端的にまとめました。

そして、音楽生成にはAI作曲ツール(Suno AI)を活用し、アップテンポで覚えやすいメロディにアレンジしています。

AIの学習をしている皆様にとって、AIを使って作られた教材で学ぶのも面白い体験になるはずです。

タイトル・歌詞の紹介

ここでは、楽曲の基本情報と歌詞を紹介します。

タイトル

AIへの攻撃手法覚えうた

歌詞

学習段階の攻撃は汚染 運用段階の攻撃は窃取 汚染は学習時 窃取は運用時

データ窃取は運用段階 モデルの出力から学習データを復元

プライバシーを盗み出す モデルインバージョン攻撃

モデル窃取は運用段階 入出力から同じ機能のモデルを複製

知的財産を盗み出す モデルエクストラクション攻撃

学習段階の攻撃は汚染 運用段階の攻撃は窃取 汚染は学習時 窃取は運用時

データ窃取は復元 モデル窃取は複製

データ汚染は学習段階 悪意のあるデータを混入

モデル全体の精度を低下 ポイズニング攻撃

モデル汚染は学習段階 パラメータや構造改ざん

特定入力に意図した誤作動 学習済みモデルを壊す

データ汚染は学習前 モデル汚染は直接改ざん

学習段階の攻撃は汚染 運用段階の攻撃は窃取楽曲の視聴

作成した楽曲は、以下のリンクから視聴可能です。

お好みのプラットフォームでお聴きください。

・youtube

・Suno AI

AIへの攻撃手法覚えうた(Suno AI)

歌詞の解説

歌詞のそれぞれの部分の意味や、G検定で問われるポイントを解説します。

まずは「学習段階の攻撃は汚染 / 運用段階の攻撃は窃取」という2つの大きな分類を確実に覚えましょう。

AIを賢く育てている最中の攻撃が「汚染」であり、完成したAIをサービスとして実際に動かしている最中の攻撃が「窃取」です。

「データ窃取(モデルインバージョン攻撃)」は、運用中のAIモデルに対する攻撃です。

モデルが出力した結果を何度も観察することで、AIの学習に使われた元のデータ(顔写真や個人情報などのプライバシー)を逆算して復元してしまう手口です。

モデルインバージョン攻撃は、データ窃取の代表的な手法であり、モデルの出力から元の学習データを復元する攻撃です。

「モデル窃取(モデルエクストラクション攻撃)」も運用段階の攻撃です。

APIなどを通じて大量の質問(入力)を行い、得られた回答(出力結果)を新しい学習データとして使います。

これにより、ターゲットと同じ能力を持つ「コピーモデル」を自分たちの手元に複製し、AIのシステムや知的財産を丸ごと盗み出します。

一方、「データ汚染(ポイズニング攻撃)」は、AIの学習段階(特に学習前)に行われます。

AIに読み込ませる学習データの中に、わざとデタラメなデータや悪意のあるデータをゴミとして混入させます。

これにより、出来上がったモデル全体の予測精度をガタガタに低下させることが目的です。

データ汚染は主に学習前のデータ収集段階で行われますが、広い意味では学習中に不正データを混入させるケースも含まれます。

「モデル汚染」は、学習段階(特に学習後)のモデル自体を狙います。

モデル汚染も学習段階の攻撃に分類されます。

データ汚染が学習データを汚染する(学習前)のに対し、モデル汚染はすでにできあがったモデルのパラメータや構造そのものを直接改ざんします。

そのため「学習後に行われるが分類上は学習段階」と整理して覚えることが重要です。

学習済みモデルの脳内(パラメータやネットワーク構造)を直接改ざんしてしまう攻撃です。

歌詞にある『学習済みモデルを壊す』とは、パラメータやネットワーク構造を改ざんすることでモデルの正常な動作を損なうことを指します。

その代表的な手口の一つが、特定の入力(トリガー)を与えた時だけ意図的に誤作動するバックドアの埋め込みです。」

楽曲に込めたメッセージ

G検定では、これらの攻撃手法の名称と「どの段階で行われるか」「何を狙っているか」を正確に結びつけることが求められます。

文字だけで暗記しようとすると混乱しがちですが、アップテンポなリズムに合わせてキーワードを口ずさむことで、記憶への定着率は格段に上がります。

試験本番で迷った時には、ぜひ頭の中でこのメロディを再生して、正しい選択肢を導き出してください。

まとめ

今回は、G検定対策として「AIへの攻撃手法覚えうた」とその解説をお届けしました。

データ窃取、モデル窃取、データ汚染、モデル汚染という4つの攻撃手法の定義と特徴をしっかり押さえておきましょう。

汚染は学習過程に介入する攻撃であり、窃取は運用中の入出力を利用して情報を盗む攻撃です。

データ窃取は学習データの復元、モデル窃取は機能の模倣、データ汚染は学習データへの不正混入、モデル汚染は学習済みモデルの改ざんと整理すると正確に理解できます。

音楽の力を借りて、楽しく効率的に合格を勝ち取ってくださいね。

コメント